つながりの縁側 (Engawa) — 今日、誰かと話せた。2026-05-25

70-90代の高齢シニアと家族のための、同世代マッチング型・人間関係再構築サービス。週1回15分の電話、月2回の少人数サロン、家族窓口で「明日、会える人がいる」をつくる。

メキシカンタコスのデリバリーサービス — 焼きたてのメキシコを、玄関まで。2026-05-25

焼きたてトルティーヤと本格サルサを、注文から玄関までスムーズに届けるメキシカンタコスのデリバリーサービス。

WellBridge Loan — 働く人の未来を、低利でつなぐ。2026-05-22

商工会議所が金融機関・加盟企業・従業員をつなぐ、給与天引き返済の従業員向け低利ローン福利厚生サービス。回収リスクを構造的に下げ、低金利を実現する。

Tsumugi(紡ぎ)— 点を、放り込むだけ。線は、AIが紡ぐ。2026-05-14

バラバラなメモ・アイデア・タスクを放り込むだけで、AIが文脈をつなぎ、意味のある線(プロジェクト・ストーリー)に紡ぎ上げる思考整理ツール。

OpenRyoko — あなたの Markdown が、AI になる。2026-05-13

自宅サーバーに住む常駐型 AI ゲートウェイ OSS。Markdown と YAML だけで人格・スキル・cron を定義できる、ベンダーロックなしの AI エージェント基盤。

Sakaen(酒縁)— AIが、あなたの 酒縁 を結ぶ。2026-05-11

飲んだ瞬間「これだ」と思える1杯に出会う、日本酒好きのためのAIコンシェルジュ。味覚プロファイル × 全国の酒屋・銘柄データで、あなたとお店をマッチング。

PriceRadar — もう価格チェックしなくていい2026-05-07

チケット・ホテル・航空券のダイナミックプライシングを24時間自動監視。安くなった瞬間にだけ通知する、Bot嫌い向けの「人間派」価格監視サービス。

データ婚活アドバイザー — 婚活市場の外にいる相手と出会う2026-04-27

国勢調査・賃金構造基本統計などの公的データをLLMで解析し、既存マッチングアプリの外にいる7-8割の独身者へアプローチする戦略コーチングAI。

Torty's TACO Stand — 毎朝、コーンから挽くトルティーヤ2026-04-27

チャウチャウ犬トルティが店主の本格タコスタンド。もちっ、こんがり、本物の味を5分で。Honest Mexicanを日本の路地裏に。

Mitorix — 薬剤師のための調剤照合AI2026-04-24

見とる(見守る)× Rx(処方)。AIカメラ×OCR×照合で、取り違え・数量ミスをゼロに近づけるクリニカル照合AI。

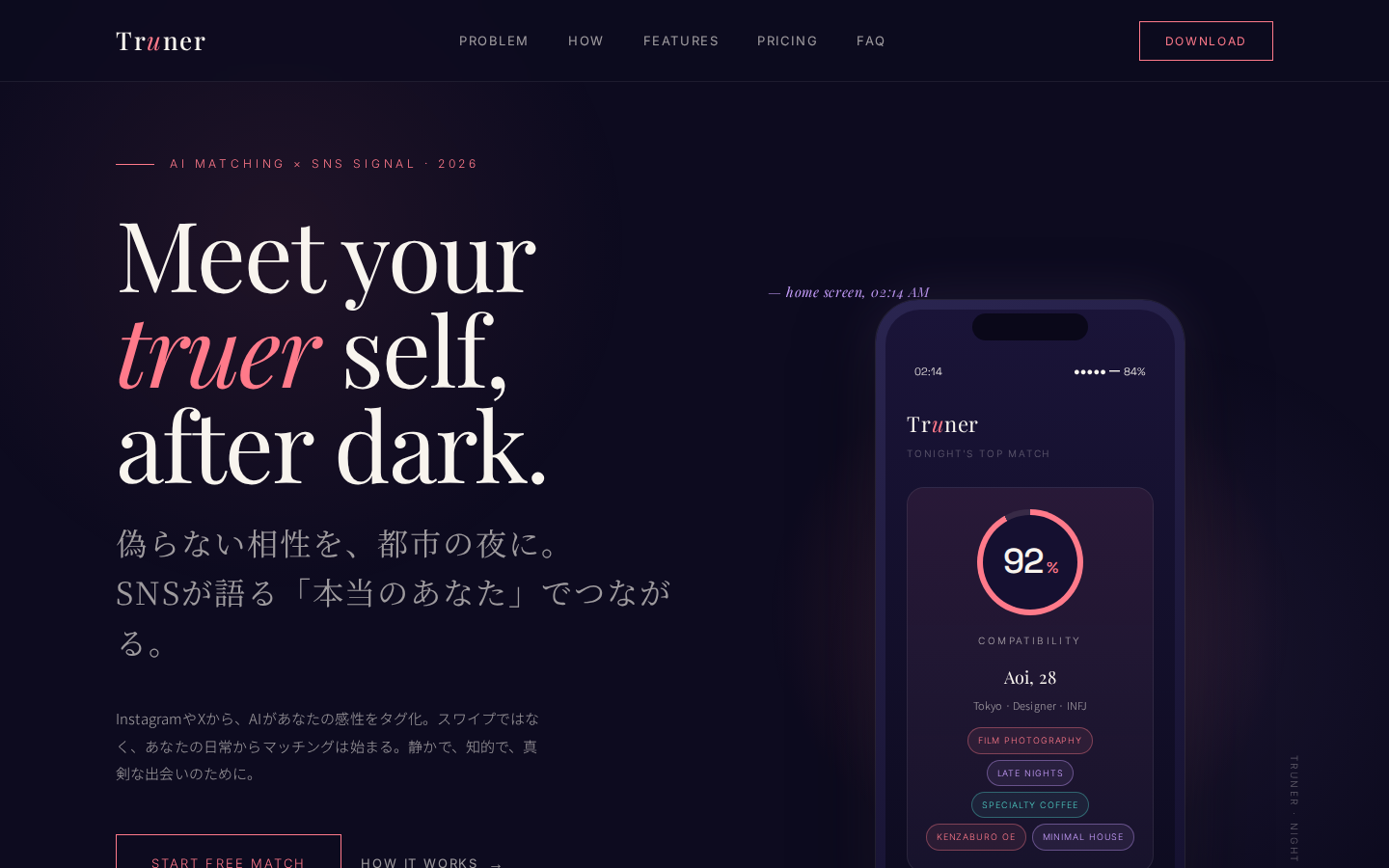

Truner — 信じられる人と、チューニングする2026-04-23

SNS連携で趣味嗜好を自動分析し、"本当に合う人"だけをAIがリコメンド。プロフィール詐称ゼロのマッチングアプリ。

HOURS — 時を味わう邸宅2026-04-22

ブティックホテルのような日常を創る、ITエリート夫婦のための注文住宅。デュアル書斎・濃密な週末・儀式の時間。

PupWhisper2026-04-21

犬の鳴き声・姿勢・表情をAIが翻訳し、犬ごとのしつけカリキュラムを自動生成する対話型ドッグトレーニング。

bp_meal_coach2026-04-17

An intelligent compass for executives who navigate life through

TacoDelivery2026-04-16

Yorkie Training Service2026-04-16

BreedMatch Yorkie2026-04-15

ヨークシャーテリア×チワワ ブリーダーマッチング2026-04-15

領収ブリッジ(Ryoshu Bridge)2026-04-14

FoodSense2026-04-13

PitchPilot2026-04-13

不動産AIスクリーナー2026-04-13

TacoRun(タコラン)2026-04-13

PhotoFolio Match2026-04-10

agent_dispatch2026-04-09

📷

Photomatch2026-04-09

ai_agent_dispatch2026-04-06

motematch2026-03-28

SakuraAI2026-03-23

NAJIMI2026-03-19

ShiftSync2026-03-17

Omotenashi AI2026-03-16

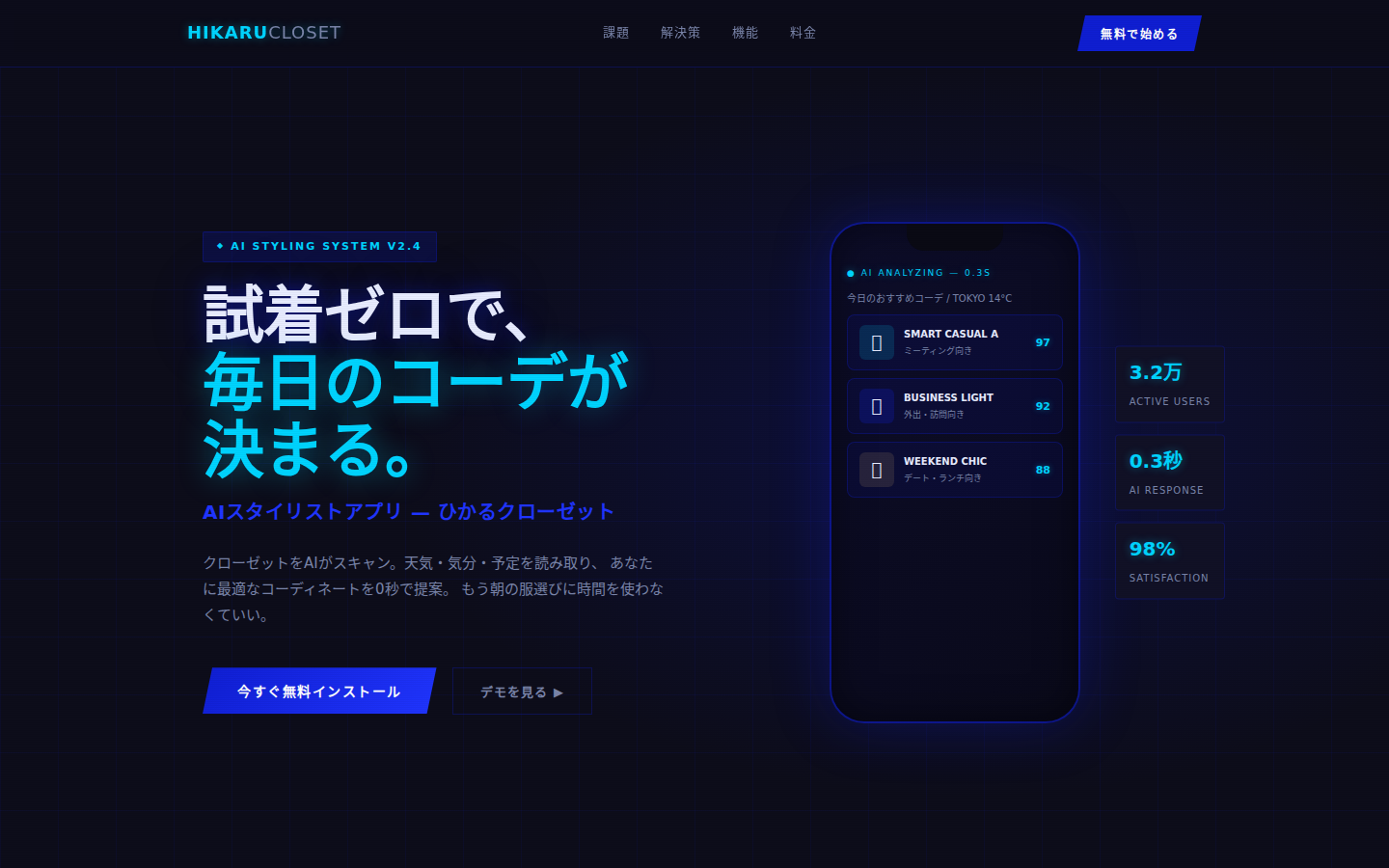

ひかるクローゼット2026-03-15

medilink_nec2026-03-15

StyleMirror2026-03-14

hikaru_closet2026-03-14

総合案内くん2026-03-13

GravRec AI2026-03-12

EquiLog2026-03-10

AIエージェント派遣サービス RYOKO(NEC仕様)2026-03-10

AIエージェント派遣事業(NEC仕様)2026-03-10

FocusFlow2026-03-09

ScheduleSync2026-03-08

AIが全員のカレンダーを読み込み、最適な「今すぐ会える時間」を瞬時に提案。日程調整という非生産的な往復をゼロにする、次世代スケジューリングサービス。